“相关”这个词很常用,或者说,很通俗,只要是想说明两个或多个变量的关系,似乎就可以考虑相关分析。但是要注意,“相关分析”并不等于我们平时在文章中所说的Pearson相关。

通常,我们在文章中,都会说相关系数等于0.72之类的内容,这里的相关系数绝大多数都是指Pearson相关。但事实上,还有很多其它相关,而且,有时你用的Pearson相关也未必正确。本文主要说一下相关分析中的一些注意事项。

问题1:相关与回归,我该选择哪个?

相关与回归都是分析变量间关系的方法,但不少人搞不清楚,我到底什么时候用相关,什么时候用回归。这个其实主要从研究目的来定,这两种方法侧重的研究目的不同。

相关(correlation)从字面意思就可以看出它描绘的是变量间的“相互”关系,即两个或多个变量不区分主次关系,重在解释变量间的关联。

而回归分析中的变量地位不同,有主次之分,注意力集中在其中的一个或几个自变量对因变量的影响,而不是因变量对自变量的影响。

在有的结构很清楚的软件中,如JMP软件,是将相关置于“多元分析”的菜单下,为什么呢?因为相关分析中,所有变量都是结果,没有原因,就是看这些变量之间的相互关系。

而回归分析则不是,只有一个结果,其它都是原因(注意这里的原因不是从时间上或因果关系上所谓的那个原因,只是为了说明问题,不是很严谨)。比如分析高血压的影响因素,高血压可以看做结果,而性别、年龄等因素可以看做原因。因为你想看的是性别、年龄等对高血压的影响,而不想反过来看高血压对年龄的影响。这就是回归分析。

问题2:没有线性相关就说明没有关系?

一般而言,我们所说的相关都是指线性相关,但这只是一般情况,而不是所有情况。比如,Pearson相关系数(主要用于正态分布数据之间的相关)和Spearman相关系数(主要用于非正态分布的数据之间的相关),这两个相关系数主要是用于线性相关的关联性度量,但是如果相关系数=0.1,并不代表说就没有相关。此时结论只能说无“线性相关”,但不能说没有“相关性”。

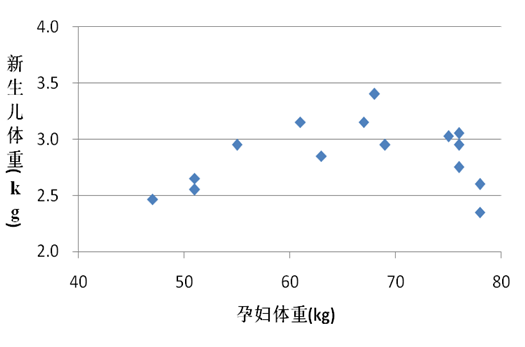

因为变量之间不仅是线性相关,也可能是曲线相关,变量之间的关系不一定是直线关系,更多的可能是曲线的关系。事实上,现实中有很多现象都不是线性的,而是非线性的。比如下图就是非线性的相关:

对于非线性的相关,如果还用Pearson相关,肯定是得不出想要的结果的,此时需要考虑曲线相关。

如何看变量间到底是线性相关还是曲线相关,最简单的方法就是通过绘制散点图来看。如果散点图大致呈直线,那就是线性相关,如果呈指数形状、抛物线形状等,则最好先将变量进行变换,如对数变换、指数变换、平方、平方根变换等。将变换后的数据再进行直线相关分析。

问题3:P值越小说明相关性越大?

我在不少文章中看过类似的结论,如某相关系数的P<0.05,就说相关性较强,某相关系数的P<0.01,就说相关性非常高。等等之类的话。

事实上,相关系数的大小跟P值没什么关系。如果用不是很严谨的话来说(但是通俗一点),P值反映的是“有没有相关”,而相关系数反映的是“相关性有多大”。也就是说,P值告诉我们,你得到的相关系数(不管多大,可能是0.9有可能是0.1)到底是真实的还是抽样误差造成的?而相关系数才是告诉我们,变量之间的关系到底有多大。

问题4:两个变量的相关性很强,可以说明它们具有很好的一致性吗?

相关性和一致性这两个词听起来很像,但并不是一回事。一致性主要用于两种属性同时作用于同一批数据,如两位专家同时对同一个人打分,两种方法同时对一批样品检测等。而关联性所用的场合要宽泛一些,基本上可以用于任意两个属性之间的关联性表示,包括一致性所用的情形。如某指标的阴性阳性与疾病发生与否的关系、两种基因型的关系等。

一般来讲,强的一致性会出现强的关联性,而强的关联性则不一定出现强的一致性。举一个简单的例子,两名专家对同一批样品结果进行评定打分。如果其中一名专家对样品的检测分值总是高于另一名专家,那这两个专家评定结果的一致性很差,但是关联性很强。

问题5:分类资料的相关性如何分析?

通常我们所说的Pearson相关主要用于连续资料的相关分析,对于分类资料,有其特有的相关系数,比较常见的有列联系数、kendall相关系数、gamma系数、lambda系数等。

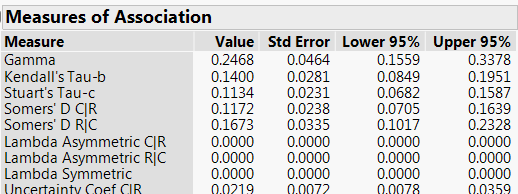

为了给大家一个直观印象,下图是JMP软件给出的各种相关系数的结果。